Ängste vor neuen Technologien gab es schon immer. In den 1980er-Jahren fürchteten sich vor allem diejenigen vor dem massenhaft ins Arbeits- und Alltagsleben eindringenden Personal Computer, die sich mit der Digitaltechnologie nicht auskannten, während Fachleute deren vielfältige Anwendungsbereiche begrüßten. Heute ist es genau umgekehrt: die breite Bevölkerung nutzt immer mehr KI-Tools wie ChatGPT, boomy, Udio, Suno, StableAudio, Avia, MusicML, Sounddraw, MusicGen, capella audio2score, LALAL.AI, Moises, BandLap…, während professionell damit befasste Anwender die Bedenkenträger sind.

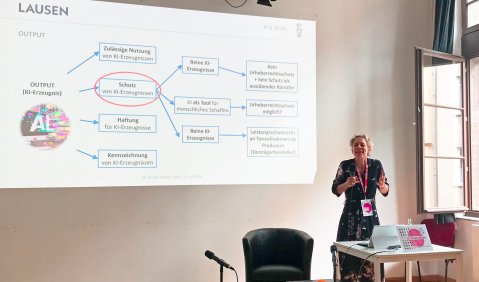

„AI MusicCon“: Präsentation von Kerstin Bäcker. Foto: Rainer Nonnenmann

Musikleben und Künstliche Intelligenz – Erste „AI MusicCon“ von SoundTrack_Cologne und Landesmusikrat NRW

Nutzen und Ängste

Zu dieser Erkenntnis kam die Anfang 2024 veröffentlichte Studie „KI und Musik: Generative Künstliche Intelligenz in der Musikbranche“. Im Auftrag von GEMA und SACEM wurden 15.000 Mitglieder beider Verwertungsgesellschaften in Deutschland und Frankreich zum Einsatz von künstlicher Intelligenz in der Musikbranche befragt. Danach nutzen 35 % der Befragten KI-Technologien und bei den unter 35-Jährigen sogar die Hälfte. Den Spitzenwert von rund 50 % erreicht der Einsatz von KI in den Genres Electro, Urban/Rap, Werbemusik, Produktionsmusik, TV-, Video- und Filmmusik. Obwohl viele Musikschaffende selber KI-Tools verwenden, sorgt sich die Mehrheit von 64 % vor Risiken und befürchten 71 %, dass KI ihre Arbeit ersetzt und sie dadurch ihren Lebensunterhalt verlieren. Handeln und Denken klaffen einmal mehr auseinander.

Den selben Widerspruch offenbarte die vom Festival SoundTrack_Cologne in Zusammenarbeit mit Prof. Francisco Tigre Moura von der IU Universität im Rahmen des Festivals vorgestellte Studie FILM-MEDIA MUSIC AND AI, mit der Festivalleiter Michael P. Aust das zahlreich erschienene Publikum der Tagung „AI MusicCon“ zum Thema „Musikleben und Künstliche Intelligenz“ begrüßte. Veranstaltet in Kooperation mit dem Landesmusikrat NRW und gefördert vom Ministerium für Kultur und Wissenschaft des Landes NRW gab es einen Tag lang im Kölner COMEDIA Theater 16 Vorträge, Gespräche, Diskussionen, Lecture-Performances, praktische Workshops und theoretische Einführungen in KI-Tools bei Produktion, Pädagogik, Marketing. Einigkeit unter den Teilnehmenden herrschte darüber, dass die generative Künstliche Intelligenz die größte technologische Veränderung seit dreißig Jahren ist und sich gravierend auf die Kreativbranche auswirkt. Ebenso bestand Konsens darüber, dass KI einstweilen noch nicht in der Lage ist, wirklich Neues zu schaffen, sondern lediglich die Masse an Klängen, Bildern, Texten, Daten neu arrangiert, mit denen sie trainiert und gespeist wurde.

Kann KI Avantgarde?

Der Leiter des Instituts für Musik und Akustik am ZKM Karlsruhe Ludger Brümmer leitete daraus den „Turing-Test der Musik“ ab, basierend auf der Frage, ob eine KI in der Lage ist, die Atonalität als Konsequenz der komplexen Tonalität zu erfinden. Da dies einstweilen nicht der Fall ist, sprach der Trossinger Kompositionsprofessor für digitale Medien den momentan existierenden KI-Tools Intelligenz und Kreativität ab. Im historischen Rückblick auf Markow-Ketten von 1906, stochastische Methoden bei Iannis Xenakis um 1960 sowie Algorithmen, Neuronale Netze, Zelluläre Automaten und die computergenerierten Vivaldi- und Bach-Stilkopien von David Cope der 1990er-Jahre machte Brümmer plausibel, dass sich regelbasierte Musik am leichtesten durch KI in beliebigen Varianten reproduzieren lässt.

Der Cellist und Produzent Anselm Kreuzer – auch Präsident des Composer Club Deutschland, des größten deutschen Branchenverbandes der Film- und Medienkomponisten – führte aus, dass zwar schon seit Jahrzehnten hybride Work-Stations mit akustischen Instrumenten, Stimmen und digitalen Tools arbeiten, inzwischen jedoch Produktionsfirmen mittels KI und Voice Cloning komplette Pop-Songs und Werbe-Jingles kreieren, die dann ein realer Producer lediglich noch zu optimieren braucht, wofür lediglich ein Bruchteil des bisherigen Zeit- und Honoraraufwands nötig ist. Im Bereich angewandter Musik für Film, Hörspiel, Werbung und Games sorgen sich Kreative folglich berechtigterweise, überflüssig zu werden. Zugleich bewerteten die Teilnehmenden die Einsatzmöglichkeiten von KI ebenso unterschiedlich wie den daraus sich ergebenden Handlungsbedarf bei Ästhetik, Ethik, Politik und Gesetzgebung.

Größter Diebstahl in der Weltgeschichte

Der Film- und Hörspielkomponist Matthias Hornschuh unterstrich, dass der augenblicklich stattfindende „größte Diebstahl in der Weltgeschichte“ schon seit Längerem systemisch verankert sei. Denn bereits Google, YouTube, Spotify sowie andere Intermediäre, Suchmaschinen und Soziale Medien hätten Inhalte anfangs nicht lizenziert und honoriert. Ebenso werden jetzt die von Musikschaffenden erarbeiteten und urheberrechtlich geschützten Inhalte ohne deren Zustimmung und Honorierung massenhaft durch in den USA oder China entwickelte KI vereinnahmt und als Anwendungen an die Bestohlenen zurückverkauft. Dadurch entsteht ein Milliarden schwerer volkswirtschaftlicher Schaden, der Politik und Gesetzgebung im globalen Maßstab dazu auffordern sollte, gegebenenfalls Schutzzölle wie beim weltweiten Autohandel zu erheben.

Die Europäische Union hat inzwischen ein AI-Büro in Brüssel eingerichtet und erarbeitet einen „AI-Act“, der für den Einsatz von KI und Deep Fake eine allgemeine Kennzeichnungspflicht vorsieht, von der nur künstlerische, satirische und fiktionale Arbeiten ausgenommen sein sollen. Nach EU-Recht ist bislang „Text-Data-Mining“ erlaubt, um durch Filtern des Internets gesellschaftliche Trends zu analysieren. Auf dieses Recht berufen sich auch die globalen Internetkonzerne, um von den Internet-Usern personenbezogene Dateien und Suchprofile durch Mustererkennungsmaschinen zu ermitteln und durch deren Nutzung und Verkauf Gewinne zu erzielen. Eine Gesetzesnovelle müsste verhindern, dass Privatdaten weiterhin in dieser Weise kapitalisiert werden. In dieser Privatisierung von Gewinn und Vergemeinschaftung von Risiko sieht Hornschuh den Tatbestand der Enteignung gegeben. Der Sprecher der Initiative Urheberrecht plädiert deswegen dafür, Innovation nicht nur gemäß dem gängigen Narrativ einseitig technologisch zu verstehen, sondern umfassender auch als Erneuerung des individuellen und kollektiven Handeln in den Bereichen Kultur, Politik, Gesetzgebung und Rechtsprechung.

„Freeware“ versus Urheberrecht

Für juristische Aufklärung sorgte die Fachanwältin für Urheber- und Medienrecht Kerstin Bäcker. Konzerne wie Microsoft oder Meta vertreten die Firmenpolitik, alles im Internet sei „Freeware“ wie ein Rohstoff nach dem Motto „Data is the new oil“, den man nach Belieben ausbeuten darf. Mittlerweile kommt es in den USA jedoch immer häufiger zu Klagen von Rechteinhabern gegen Internet-Konzerne und KI-Anbieter. Beispielsweise klagte die New York Times, dass Millionen ihrer Artikel ohne Lizenzierung und Honorierung von OpenAI und Microsoft genutzt werden. Inzwischen schließen daher erste KI-Anbieter Partnerschaften mit Unternehmen ab, die Inhalte generieren. Ende 2023 verkündeten OpenAI und Springer-Konzern eine globale Partnerschaft, bei der die Springer-Presse (unter anderem POLITICO, BUSINESS INSIDER, BILD, WELT) den von OpenAI entwickelten ChatGPT mit aktuellen und verlässlichen Inhalten versorgt und dafür entsprechend vergütet wird.

Andere KI-Firmen wie etwa boomy setzen indes auf Verschleierung der Datenherkunft durch sogenannte Gaffer-Taps, die durch gezielte Abwandlungen der Suchergebnisse systematisch verhindern, dass urheberrechtlich geschützte Inhalte tatsächlich im Original erscheinen und dadurch bloßlegen, dass die KI mit urheberrechtlich geschützten Inhalten trainiert und gespeist wurde. Zudem verlangen viele KI-Anbieter in ihren Allgemeinen Geschäftsbedingungen, dass ihre Gratisversionen (die Bezahlversionen vermutlich ebenso) alles Fragen und Prompten der User zur Optimierung der KI nutzen und alle generierten Inhalte auch anderen Usern bereitstellen dürfen. boomy verpflichtet seine Nutzer sogar vorsorglich dazu, das Unternehmen pauschal von allen Regressforderungen wegen möglicher Verletzungen von Urheber- und Leistungsrechten freizusprechen.

„AI MusicCon“: Präsentation von Thomas Hanz. Foto: Rainer Nonnenmann

KI im Musikschulunterricht

Für die im Landesmusikrat NRW organisierten Musikverbände und rund 7.500 Musikschullehrenden bot der Gitarrist, Komponist, Musikpädagoge und Festival-Macher Thomas Hanz konkrete Hinweise auf Anwendung von „KI im Musikschulunterricht“. Im Zuge der Corona-Pandemie wurden in NRW neben allgemeinbildenden Schulen auch Musikschulen mit neuester digitaler Hard- und Software ausgestattet. Der Referent für Digitalisierung des Landesverbands der Musikschulen in NRW vermittelt seitdem die damit verbundenen praktischen Möglichkeiten. Mit Large Language Models wie ChatGPT lassen sich schnell und einfach Programmideen recherchieren, Kommentartexte schreiben und Plakate entwerfen. Mit Cadenz Live Accompanist können einzelne Stimmen aus der Audiodatei eines Orchester- oder Kammermusikwerks entfernt werden, so dass die vakante Partie dann von einer Schülerin gespielt werden kann. Im Gegensatz zu den starr ablaufenden Schallplatten „Music Minus One“ reagiert das Programm bei mehrmaligem Spielen immer genauer auf Tempo, Atempausen und Phrasierung des Mitspielenden und kann es das gesamte Stück außerdem problemlos in beliebige Tonarten oder Stimmlagen transponieren.

Mittels hookpad lassen sich einfache Melodien harmonisieren und mit Schlagzeug zu Bossa Nova, Dark Electro, Metal und x-beliebigen anderen Stilen kombinieren sowie als Partitur und Einzelstimmen für entsprechend vorhandene Instrumente einrichten. Ebenso können stupide Einspielübungen durch Harmonisierung für Schülerinnen und Schüler für das heimische Üben reizvoller gestaltet werden. Thomas Hanz hat bereits auch Ideen für künftige Anwendungen. Der Unterricht könnte als Video mitgeschnitten und bei wichtigen Inhalten vom Lehrenden mit Markern versehen werden, die ein Computerprogramm dann automatisch zu einer Kurzfassung komprimiert, die sich zu Hause beim Üben als sicht- und hörbares Hologramm zum richtigen Nachmachen abrufen lässt. Interaktive Videobrillen könnten schließlich auch dafür sorgen, dass ein im Raum performender Geiger die zu spielenden Noten dennoch immer vor die Augen hat.

SEO, Memes, Fake-Influencer

Aus Tallinn angereist war Marju Sokman mit einem Hands on für „Marketing training and consulting for micro-entrepreneurs“. Ihre Präsentation „Adressing Target Groups and Marketing with AI“ zeigte Einsatzmöglichkeiten von KI-Tools zu Werbezwecken und Search Engine Optimization (SEO). Um beispielsweise ein Musikfestival möglichst effektiv mit großer Reichweite und hohen Klickzahlen zu bewerben, sollte man das vorhandene Programm in viele kleine Texte, Videos, Bilder und Headlines filetieren und auf möglichst viele verschiedene Kanälen verteilen. Beim Generieren von Headlines mit hoher Catchiness helfen Programme wie Claude.ai, gemini oder perplexity. Mittels OpusClip lässt sich eine halbstündige Präsentation häppchengerecht für ungeduldige User automatisch in leicht konsumierbare Zweiminuten-Sequenzen samt passenden Zwischenüberschriften zerlegen. Statt selbst passende Suchbegriffe auszuwählen, um die Trefferquote zu erhöhen, übernimmt auch das die KI. Mit Viggl.AI lassen sich Memes kreieren, bei denen man in die Rolle von Superstars schlüpfen und sich in Stadien von zehntausenden Fans bejubeln lassen kann.

Mithilfe von heygen kreiert man Avatare, die mit völlig anderer Erscheinung und Stimme den eigenen Content bewerben als wären es unabhängige Personen. Bot-Farmen „züchten“ massenhaft solche Fake-Influencer. Die Referentin aus dem hoch-digitalisierten Estland zeigte große Begeisterung für solche KI-gestützten Werbemaßnahmen, aber keinerlei Problembewusstsein für die demokratiegefährdende Wirkung solch toxischer Meinungs- und Marktmanipulation. Der geplante AI-Act der EU wird automatisierte Bots nicht verhindern, aber immerhin die rechtliche Grundlage dafür liefern, deren Hersteller juristisch zu verfolgen. Wie tiefgreifend die Wahrnehmung schon jetzt manipuliert ist, zeigen Studien darüber, dass KI-generierte Avatare für viele Menschen natürlicher wirken als reale Personen.

Weiterlesen mit nmz+

Sie haben bereits ein Online Abo? Hier einloggen.

Testen Sie das Digital Abo drei Monate lang für nur € 4,50

oder upgraden Sie Ihr bestehendes Print-Abo für nur € 10,00.

Ihr Account wird sofort freigeschaltet!